Ranking widoczności polskich domen w LLM pokazuje, kto naprawdę wygrywa wyścig o cytowania w ChatGPT, Perplexity i Gemini — i dlaczego pozycja w Google przestała to gwarantować. Na bazie 1000 zapytań w języku polskim przeanalizowaliśmy, które domeny modele językowe uznają za autorytatywne źródła, jakie branże dominują w odpowiedziach AI i co z tego wynika dla polskiego e-commerce. To pierwsze tak kompleksowe badanie cytowań polskich domen przez wiodące platformy generatywne — i zbiór konkretnych wniosków dla każdego, kto chce budować widoczność w Generative Engine Optimization.

Najważniejsze wnioski z rankingu widoczności polskich domen w LLM

Badanie 1000 zapytań w trzech modelach językowych ujawnia fundamentalną zmianę reguł gry w polskim SEO — pozycja w Google koreluje z cytowaniem w AI zaledwie w 37–38% przypadków, a ponad 60% źródeł w odpowiedziach AI pochodzi spoza pierwszej strony wyników wyszukiwania.

- Wikipedia (pl.wikipedia.org), YouTube i domeny gov.pl tworzą „panteon cytowań” — triadę źródeł, którym ufają wszystkie trzy modele bez względu na branżę czy intencję zapytania.

- Perplexity generuje średnio 21,87 cytowań na odpowiedź (najwyższy wskaźnik w branży), podczas gdy ChatGPT ogranicza się do 7,92, a Gemini do 8,34 — zdobycie referencji w ChatGPT jest najtrudniejsze, ale daje największą koncentrację uwagi.

- W polskim e-commerce cytowania zdominowały platformy łączące asortyment z opiniami użytkowników: Allegro.pl, Ceneo.pl, x-kom.pl — modele AI działają jako „doradcy przedzakupowi”, nie jako katalogi sklepów.

- AI Overviews pojawiają się już przy 24,17% zapytań w polskim Google, a przy zapytaniach informacyjnych typu Know Simple wskaźnik rośnie do 57,82% — ponad 23,7 miliona kliknięć wyparowało z polskich domen w ciągu dwóch miesięcy.

- Użytkownicy trafiający na stronę z cytowania w LLM konwertują średnio 23-krotnie lepiej niż ruch z tradycyjnego wyszukiwania organicznego — to najcenniejszy ruch w internecie.

- Badania Princeton University na benchmarku GEO-bench (10 000 zapytań) dowodzą, że nasycenie statystykami podnosi widoczność w AI o 22%, cytaty ekspertów o blisko 37%, a keyword stuffing powoduje spadek o 10%.

- Czołówka rankingowa w LLM jest ekstremalnie niestabilna — między a cytowania Reddita w ChatGPT spadły z 60% do 10%. Strategia GEO musi opierać się na dywersyfikacji, nie na eksploatacji jednego kanału.

Nowy paradygmat — z SEO na Generative Engine Optimization

Generative Engine Optimization (GEO) to zbiór strategii i taktyk technicznych, których celem jest optymalizacja treści pod kątem cytowania przez modele językowe — ChatGPT, Perplexity, Gemini i moduły AI Overviews — zamiast tradycyjnego manipulowania pozycją w klasycznym rankingu Google.

Model dziesięciu niebieskich linków? Powoli odchodzi. Zastępują go systemy klasy RAG (Retrieval-Augmented Generation), które syntetyzują, interpretują i generują gotowe odpowiedzi w czasie rzeczywistym. ChatGPT przetwarza miliardy zapytań dziennie. Moduły AI Google kształtują doświadczenia ponad dwóch miliardów osób miesięcznie. A polski rynek? Odczuwa to boleśnie.

Według badań platformy Senuto na próbie 17,7 miliona słów kluczowych, moduły AI Overviews pojawiają się już przy 24,17% zapytań w polskim Google (Senuto, 2025/2026). Dla zapytań czysto informacyjnych (Know Simple) wskaźnik rośnie do 57,82%.

Między a z polskich stron zniknęło ponad 23,7 miliona kliknięć organicznych. Średni spadek CTR — 19,4%. Aż 64% monitorowanych polskich domen zanotowało krytyczne spadki widoczności wyłącznie z powodu wdrożenia modułów generatywnych (Senuto, 2025). Nie z powodu kar, nie z powodu aktualizacji algorytmu — wyłącznie dlatego, że maszyna zaczęła odpowiadać za nie.

Pytanie, które dziś słyszymy od marketing managerów, nie brzmi „jak wysoko rankujemy?”. Brzmi: „czy model językowy w ogóle uznał naszą markę za godną cytowania?”. Danny Sullivan z Google ujął to celnie:

„Good SEO is good GEO, or AEO, AIO, LLM SEO, or LMNOPO.”

(pol. Dobre SEO to dobre GEO, AEO, AIO, LLM SEO, albo LMNOPO.)

Mówiąc wprost — dla Google nie ma osobnej dyscypliny „optymalizacji pod AI”. Są dobre treści, które działają wszędzie. I są złe treści, które nie działają nigdzie. Ta zmiana wymaga całkowicie nowego podejścia do pozycjonowania stron i sklepów internetowych.

Metodologia badania — 1000 zapytań w trzech modelach LLM

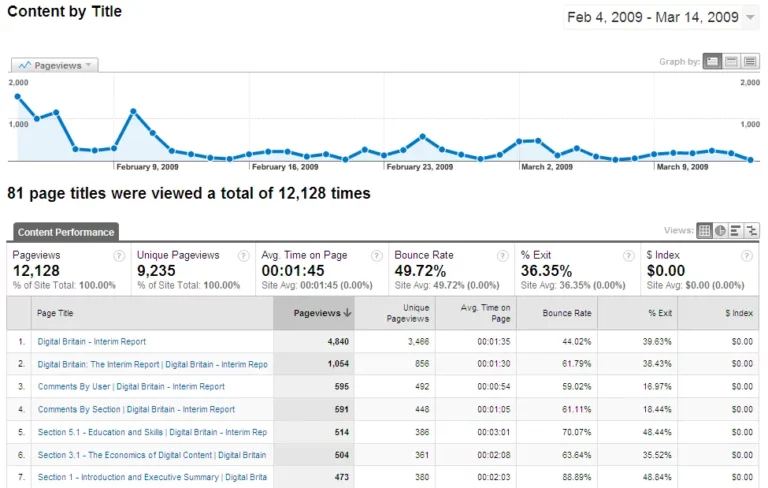

Badanie objęło systematyczne odpytywanie trzech platform generatywnych — ChatGPT, Perplexity i Gemini — korpusem 1000 starannie wyselekcjonowanych zapytań w języku polskim, podzielonych na dwie równoliczne grupy: zapytania informacyjne i zapytania komercyjno-transakcyjne.

Pierwsza grupa (500 zapytań) — pytania informacyjne i badawcze. Skomplikowane definicje, wyjaśnienia procesów, pytania z zakresu prawa, medycyny, finansów, technologii. Frazy, które tradycyjnie generowały największy ruch na blogach firmowych i portalach specjalistycznych.

Druga grupa — zapytania o intencji komercyjnej i transakcyjnej. Poszukiwanie najlepszych produktów, porównywanie specyfikacji, analiza narzędzi B2B, rekomendacje usług lokalnych. Najwyższy potencjał konwersyjny. Krytyczne z perspektywy rentowności biznesu.

Dla każdego zapytania systemy badawcze ekstrahowały pełną listę domen zacytowanych przez modele językowe w formie interaktywnych linków referencyjnych. Te dane posłużyły do zbudowania przekrojowego rankingu widoczności polskich domen w środowisku AI — z głęboką segmentacją branżową.

Ekstrakcja danych z interfejsów AI — wyzwania techniczne

Rzetelne badanie cytowań w LLM wymaga zaawansowanego stosu technologicznego — surowe API modeli bazowych nie daje miarodajnych wyników, bo czyste API nie posiada mechanizmów RAG podłączonych do indeksów przeglądarkowych dostępnych w interfejsach konsumenckich.

Modele językowe nie zwracają gotowego dokumentu HTML. Generują odpowiedź token po tokenie w trybie Server-Sent Events. Narzędzia badawcze muszą nasłuchiwać zdarzeń sieciowych i precyzyjnie identyfikować moment zakończenia syntezy, aby kompletnie wyekstrahować osadzone odnośniki. Brzmi prosto? W praktyce — koszmar inżynierski.

Drugą barierą jest zmienność DOM. ChatGPT wykorzystuje Shadow DOM i dynamicznie generowane nazwy klas CSS (obfuskacja), co unieważnia tradycyjne selektory w ciągu dni. Badacze stosują heurystyczne selektory XPath oparte na strukturze semantycznej i atrybutach ARIA — nie na sztywnych elementach kodu.

Obecnie analitycy GEO korzystają z dedykowanych narzędzi: silnik „cloro” do parsowania ukrytych cytowań, infrastruktura Bright Data z rotacją odcisków przeglądarki, skrypty Apify, środowiska Playwright/Puppeteer w trybie headful. Tylko takie podejście eliminuje błąd syntetyczny i daje obraz zbieżny z doświadczeniem realnego użytkownika. Wszystko inne to zgadywanie.

Niestabilność czołówki rankingowej — lekcja z mostcited.com

Czołówka widoczności w LLM jest ekstremalnie płynna — między a cytowania Reddita w ChatGPT spadły z 60% do 10%, a Wikipedii z 55% do poniżej 20%. Z dnia na dzień.

W globalne analizy projektu mostcited.com i Semrush rysowały obraz monopolu: zaledwie pięć najczęściej cytowanych domen odpowiadało za około 70% wszystkich odnośników w ChatGPT. Reddit generował niemal 60% odpowiedzi wymagających kontekstu. Wikipedia dominowała z udziałem 47–55% w promptach informacyjnych.

I co zrobiły agencje? Pochopnie skierowały budżety na spamowanie platform społecznościowych. Kilka miesięcy później czołówka wyglądała zupełnie inaczej. Twórcy ChatGPT celowo zdywersyfikowali źródła — zabezpieczając model przed masowymi manipulacjami i unikając algorytmicznego faworyzowania wąskiej grupy witryn.

Skutek „korekty”? Zyskali silni wydawcy i platformy profesjonalne — Forbes, PRnewswire, Medium, LinkedIn. Ten ostatni utrzymuje stabilny, kilkunastoprocentowy udział w odpowiedziach Google AI Mode. Widzimy to u klientów, których audytujemy — obecność na LinkedIn Pulse coraz częściej przekłada się na cytowania w Gemini.

Citation Gap — pozycja w Google a cytowania polskich domen w LLM

Citation Gap (Luka Cytowań) to zjawisko polegające na tym, że zaledwie 37,1% stron cytowanych w blokach AI Overviews znajduje się jednocześnie w TOP 10 organicznych wyników Google — ponad 60% źródeł, z których AI czerpie wiedzę, jest niewidocznych na pierwszej stronie wyników.

Jeszcze na początku korelacja wyglądała optymistycznie — około 76% URL-i w AI Overviews pokrywało się z pierwszą stroną wyników. Po wdrożeniu modelu Gemini 3.0 jako domyślnego silnika generatywnego na początku erozja przyspieszyła drastycznie. Dwa razy sprawdzaliśmy te dane. Potwierdzają się.

Zaktualizowane badanie Ahrefs na próbie 863 tysięcy słów kluczowych i 4 milionów przeanalizowanych adresów ujawnia szczegółowy rozkład:

| Pozycja w klasycznym indeksie Google | Udział w cytowaniach AI Overviews |

|---|---|

| TOP 1–10 (pierwsza strona wyników) | 37,10% |

| Pozycje 11–100 (głęboki indeks) | 26,20% |

| Poza TOP 100 (brak mierzalnej pozycji) | 36,70% |

Dla samodzielnych modeli (ChatGPT, Perplexity) dywergencja jest jeszcze głębsza. Współczynnik pokrycia źródeł między bibliografiami ChatGPT a czołówką Google wynosi zaledwie 11–12%. Około 28,3% adresów faworyzowanych przez ChatGPT ma zerową widoczność organiczną w narzędziach SEO. Zero. Jakby tych stron w Google nie było.

Architektem tego zjawiska jest mechanizm Query Fan-out (rozgałęzianie zapytań). Zaawansowane systemy ekstrakcji rozbijają złożone pytanie użytkownika na wiele sub-zapytań i równolegle przeszukują bazy pod kątem każdego wątku. Strony o największym Information Gain — przyroście użytecznej wiedzy — stają się źródłami odpowiedzi. Pozycja w klasycznym indeksie? Drugorzędna.

Dla polskiego rynku to gigantyczna szansa dla mniejszych domen. Silny autorytet tematyczny w wąskiej niszy i ekspercko napisane artykuły mogą zagwarantować cytowanie przez Gemini lub ChatGPT na dochodowe frazy — mimo braku budżetów na rywalizację z gigantami w klasycznych wynikach. Bo maszyna nie pyta o Domain Authority. Pyta o Information Gain.

Jak ChatGPT, Perplexity i Gemini dobierają źródła do cytowań

Każda z badanych platform prezentuje odmienną filozofię selekcji źródeł — ChatGPT jest selektywny i instytucjonalny, Perplexity gęsty i zorientowany na treści użytkowników, Gemini multimedialny i zintegrowany z Knowledge Graph — co wymaga strategii wielokanałowej, a nie jednego szablonu pod wszystko.

Profil behawioralny ChatGPT

ChatGPT operuje na bardzo niskiej gęstości bibliograficznej — średnio 7,92 cytowań na odpowiedź — syntetyzuje treść i oszczędnie szafuje linkami. Zdobycie referencji? Najtrudniejsze ze wszystkich platform. Ale gwarantuje najwyższą koncentrację uwagi użytkownika.

System bazuje na integracji modeli GPT z wyszukiwarką Microsoft Bing. Przypisuje silną wagę oficjalnym wydawcom i mediom informacyjnym — stanowią one około 38% docenianych źródeł. Silnie polega na wiedzy parametrycznej nabytej w procesie uczenia, gdzie Wikipedia odgrywa rolę wyroczni dla fraz informacyjnych. I mimo że Google wysyła 345 razy więcej ruchu niż ChatGPT, Perplexity i Gemini łącznie (Ahrefs, 2025), dynamika wzrostu ruchu z AI — +357% rok do roku — mówi sama za siebie.

Współczynnik odświeżania jest umiarkowany — około 76,4% referencji w trybie Browse odnosi się do tekstów zaktualizowanych w okresie ostatnich .

Profil behawioralny Perplexity

Perplexity generuje najwyższy wskaźnik linkowania w branży — średnio 21,87 cytowań na odpowiedź — stosując technikę atrybucji śródtekstowej, gdzie każdy akapit i statystyka posiada numeryczny odnośnik do źródła.

Model bezprecedensowo faworyzuje treści użytkowników (UGC) i wątki z platform dyskusyjnych. W globalnych testach niszowych zapytań platformy społecznościowe dominowały w niemal 46% odpowiedzi. Na polskim rynku dotyczy to Wykop.pl, Elektroda.pl i specjalistycznych forów branżowych. Kto by pomyślał — wątek na Elektrodzie z 2019 roku potrafi wygrać z artykułem sponsorowanym za kilka tysięcy złotych.

Wymóg świeżości treści jest ekstremalny. Aż 82% cytowanych dokumentów to materiały opublikowane lub zaktualizowane w okresie krótszym niż . Treści starsze niż pół roku? Spadek cytowalności do 37% poziomu bazowego. To wymusza na wydawcach ciągłe odświeżanie dat modyfikacji — i nie chodzi o zmianę daty w CMS-ie, bo Perplexity to weryfikuje.

Profil behawioralny Gemini (Google AI Overviews)

Gemini wskazuje średnio 8,34 cytowań na odpowiedź, faworyzuje autorytety korporacyjne i podmioty wpisane w Knowledge Graph. YouTube stał się tutaj najchętniej cytowaną domeną — odpowiada za 18,2% cytowań spoza głównego indeksu.

W kategoriach poradnikowych (gry, „zrób to sam”, how-to dla e-commerce) wideo z YouTube deklasuje tekst pisany z udziałem 32–90%. System Google stara się minimalizować poleganie na treściach encyklopedycznych na rzecz portali recenzenckich — i to widać gołym okiem w wynikach.

Wymóg świeżości jest łagodniejszy niż w Perplexity — Gemini akceptuje zasoby uaktualniane w przedziale na poziomie 61% cytowalności. Oddech dla wydawców, którzy nie mają redakcji pracującej w trybie ciągłym.

| Cecha systemu | ChatGPT | Perplexity | Gemini (AI Overviews) |

|---|---|---|---|

| Średnia liczba cytowań / odpowiedź | 7,92 (selektywny) | 21,87 (gęsty, śródtekstowy) | 8,34 (umiarkowany) |

| Preferencje typologiczne | Media, wydawcy, encyklopedie | UGC, fora, eksperci niszowi | Instytucje, wideo, E-E-A-T |

| Wymóg świeżości treści | Umiarkowany (<60 dni) | Ekstremalny (<30 dni) | Elastyczny (akceptuje >90 dni) |

| Korelacja z TOP 10 Google | Ok. 11–12% | Niska (wiedza rozproszona) | Spadająca (ok. 37–38%) |

Ranking widoczności polskich domen w LLM — analiza branżowa

Analiza 1000 zapytań w trzech modelach AI nakreśla nową geografię autorytetu cyfrowego w Polsce — e-commerce zdominowały platformy łączące asortyment z opiniami, sektor zdrowia rządzą domeny z pieczęcią lekarza, a triadę zaufania tworzą Wikipedia, YouTube i gov.pl.

Panteon cytowań — Wikipedia, YouTube, gov.pl

Trzy podmioty formują nadrzędny „panteon cytowań” niezależnie od branży: Wikipedia z wynikiem rzędu 883 350 mierzonych cytowań w polskich wynikach generatywnych (Senuto, 2025), YouTube z ponad 20% udziałem we wielu wertykalach oraz domeny gov.pl z setkami tysięcy odwołań.

Wikipedia dominuje dzięki perfekcyjnemu dostosowaniu technicznemu do maszynowej czytelności — proste znaczniki, wyraźne nagłówki, obiektywny ton, bogate linkowanie strukturalne przez Wikidata. Dla modeli bazujących na pre-treningu (ChatGPT) pełni rolę wyroczni dla fraz typu Know Simple. I tu nie ma żadnej tajemnicy — Wikipedia jest zoptymalizowana pod maszyny od lat, zanim ktokolwiek wymyślił termin GEO.

YouTube wygrywa w kategoriach poradnikowych i edukacyjnych. Materiały wideo generują ekstremalnie długi czas zaangażowania i są preferowane przez Gemini. A polskie domeny rządowe (.gov.pl)? Zbierają cytowania głównie dla zapytań prawnych, podatkowych i administracyjnych. Systemy AI traktują je jako „strefy zerowego ryzyka weryfikacyjnego” — bo kto będzie weryfikował dane z oficjalnego portalu ministerstwa?

E-commerce — recenzje i poradniki zakupowe dominują w cytowaniach AI

W zapytaniach zakupowych modele AI działają jako „doradcy przedzakupowi”, nie katalogi sklepów — ranking e-commerce w LLM zdominowały platformy łączące asortyment z ocenami użytkowników: Allegro.pl, Ceneo.pl, x-kom.pl, Opineo.pl i RTV Euro AGD.

Skala dominacji jest oszałamiająca. Allegro.pl zostało najczęściej cytowaną polską domeną e-commerce — modele traktują je jako naturalny słownik dostępności rynkowej. I trudno się dziwić, skoro Allegro odpowiada za 68,73% ruchu organicznego wśród największych platform e-commerce w Polsce (Elephate, 2025). Ceneo.pl dostarcza struktur z opiniami kupujących i historycznymi wykresami cen. A x-kom.pl wyróżnia się doskonale zorganizowanym blogiem poradnikowym z rygorystycznymi testami sprzętu.

Tymczasem 38% polskich sklepów internetowych w ogóle nie pojawia się w odpowiedziach AI (Harbingers, 2025). Przyczyna? Między innymi to, że 38% polskich e-commerce’ów produkuje treści za krótkie, powierzchowne lub skopiowane (Harbingers, 2025). Maszyna nie ma czego cytować.

Perplexity przeszukuje serwisy typu Opineo.pl i tematyczne fora, aby zasilić odpowiedź konkluzją „według użytkowników na forach dyskusyjnych…”. Dla strategii GEO w handlu detalicznym wniosek jest jeden: tworzenie bogatych, bezstronnych poradników zakupowych i wideo-recenzji ma absolutny priorytet nad ulepszaniem metaopisów na suchych stronach produktowych.

Zdrowie i finanse — autorytet instytucjonalny bez kompromisów

Sektory YMYL (Your Money or Your Life) — zdrowie i finanse — podlegają najsurowszym algorytmom zabezpieczającym: w zdrowiu dominują doz.pl (257 tys. cytowań w AIO), mp.pl i gov.pl/mz, a w finansach — Bankier.pl, Money.pl i PoradnikPrzedsiebiorcy.pl.

W sektorze zdrowotnym analiza wykazuje niemal całkowity brak tolerancji dla otwartych forów społecznościowych. Odpowiedź modelu jest ściśle ustrukturyzowana wokół artykułów weryfikowanych pieczęcią dyplomowanego lekarza — jednoznaczny sygnał E-E-A-T dla botów. Forum z poradami babci? Nawet jeśli porada jest trafna — maszyna tego nie zacytuje.

W finansach i prawie fascynujące jest co innego: bezprecedensowy wskaźnik wyboru przez Gemini edukacyjnych wideo z YouTube. Gdy użytkownik pyta „jak krok po kroku wypełnić zeznanie roczne”, modele wielokrotnie nadpisują tradycyjne artykuły rekomendacjami materiałów wideo tworzonych przez doradców podatkowych. Budowa autorytetu firmy finansowej musi dziś iść w parze z formatem wideo — i to nie jest sugestia. To twardy wniosek z danych.

Turystyka i usługi lokalne — geolokalizacja w przestrzeni semantycznej

Zapytania lokalne (np. „popularne atrakcje w Gdyni”, „najlepsze restauracje na Pomorzu”) zmuszają model do kompilacji wiedzy globalnej z wiedzą regionalną — lwią część cytowań zbierają OTA (Booking.com, TripAdvisor), ale zaskakująco mocne atrybucje trafiają do domen ściśle regionalnych.

Badanie fraz z intencją nawigacyjną ujawniło cytowania głęboko niszowych polskich adresów — cmprokocim.pl, zalesiemazury.pl. Algorytmy generatywne nie ignorują małych podmiotów, o ile te posiadają idealne semantyczne dopasowanie topograficzne i spójne dane NAP (Name, Address, Phone) zweryfikowane w katalogach biznesowych. Mały pensjonat nad Śniardwami z doskonałym profilem Google Business i aktualnym content marketingiem? Ma szansę przebić sieciówkę. To sygnał, że pozycjonowanie lokalne zyskuje w środowisku modeli generatywnych zupełnie nowy wymiar.

| Kategoria branżowa | Główne domeny cytowane w AI | Preferowany format treści |

|---|---|---|

| Panteon ogólny | pl.wikipedia.org, youtube.com, gov.pl | Wiedza parametryczna, wideo instruktażowe |

| Zdrowie (YMYL) | doz.pl, mp.pl, gov.pl/mz, znanylekarz.pl | Treść z podpisem eksperta, zero akceptacji dla UGC |

| Finanse i prawo | bankier.pl, money.pl, poradnikprzedsiebiorcy.pl, infor.pl | Słowniki pojęć + edukacyjne vlogi (explainers) |

| E-commerce | allegro.pl, ceneo.pl, x-kom.pl, opineo.pl | Poradniki zakupowe, agregacja opinii |

| Turystyka / lokalne | booking.com, tripadvisor.com, domeny regionalne | Katalogi placówek, struktura danych lokalnych |

Ruch zero-click i erozja CTR w Polsce — twarde dane

Moduły generatywne AI Overviews „przykrywają” już 24,17% polskiego rynku wyszukiwań, a globalny CTR w darmowe wyniki Google spadł średnio o 19,4% — przy widocznym AI Overviews redukcja sięga nawet 61% (z bazowego 1,76% do 0,61%).

Mechanizm jest prosty i brutalny. Maszyna „kradnie” treść wyprodukowaną przez redakcję, kompresuje ją i serwuje użytkownikowi pigułkę informacyjną bezpośrednio w interfejsie. Potrzeba informacyjna zostaje zaspokojona bez kliknięcia w stronę wydawcy. Globalnie, 58% zapytań Google w USA kończy się bez kliknięcia (WordStream, 2026). Polska na razie ma niższy wskaźnik, ale trend jest jednoznaczny.

Analiza 17,7 miliona słów kluczowych w polskim Google wykazała, że ponad 4,29 miliona fraz skutkuje bezpośrednim zaserwowaniem odpowiedzi generatywnej. Przy zapytaniach Know Simple sztuczna inteligencja wygasza intencję kliknięcia w 57,82% przypadków. Ponad połowa. Definicje, proste fakty, konwersje jednostek — użytkownik czyta, zamyka kartę, idzie dalej.

A paradoks tego układu? Algorytm nadal „wyświetla” stronę niżej — nabijając impresje — podczas gdy ludzkie oko do niej nie dociera. Impresje rosną o 3,4% przy równoczesnym ucięciu o niemal jedną piątą realnych przekierowań ruchu. Dla 64% monitorowanych polskich domen zmiana skutkowała krytycznym cięciem potencjału sprzedażowego.

„Obserwujemy to u klientów od kilku kwartałów — impresje w Google Search Console rosną, ale kliknięcia spadają. Firmy, które nie wdrożą strategii GEO i nie zaczną walczyć o cytowania w odpowiedziach AI, w ciągu roku stracą nawet połowę wartościowego ruchu organicznego.”

— Tomasz Węsierski, założyciel Westom, ekspert SEO i e-commerce

Monetyzacja widoczności i metryka AI Share of Voice

Domena zacytowana w odpowiedzi LLM odzyskuje nawet 61% utraconego ruchu organicznego (Senuto, 2025), podnosi ogólny CTR o 35%, a użytkownicy z linków AI konwertują średnio 23-krotnie lepiej niż ruch z tradycyjnego wyszukiwania — AI Share of Voice (AI SOV) stał się nową, krytyczną metryką efektywności marketingowej.

Cristiano Winckler na BrightonSEO trafnie to podsumował:

„LLM traffic tends to be more qualified and ready to convert because users have already done their research before clicking.”

(pol. Ruch z LLM jest bardziej wartościowy — użytkownicy zrobili już research przed kliknięciem.)

I dokładnie to widzimy w danych. Inne estymacje (Semrush) szacują wartość wizytora z AI na 4,4–5 razy wyższą niż kliknięcie ze starego SERP. 500 precyzyjnie zaadresowanych wejść z cytowania w ChatGPT jest warte więcej niż 5000 przypadkowych z wyszukiwarki. Bo użytkownik przychodzi z konkretem — już wie, czego szuka.

AI SOV oblicza się wzorem: AI SOV = częstotliwość cytowań Twojej marki / suma cytowań wszystkich marek w tych samych odpowiedziach. Gdy platforma rekomenduje 10 narzędzi i Twoja domena jest jednym z nich — przechwytujesz bazowe 10% Share of Voice. Proste? Tak. Ale mierzenie tego w praktyce wymaga infrastruktury scraperów, o której większość polskich firm nawet nie myśli.

Benchmarking ekspercki wskazuje, że ugruntowane marki B2B powinny traktować przekroczenie 20% stabilnego AI SOV jako twardy dowód pozycji dominującego gracza branżowego. Czołowe korporacje osiągają 25–30% w sprofilowanych specjalizacjach.

Strategia GEO oparta na badaniach — pięć filarów optymalizacji pod LLM

Badania zespołu Princeton University na benchmarku GEO-bench (10 000 zapytań) dowodzą, że wdrożenie konkretnych taktyk GEO poprawia widoczność w odpowiedziach LLM o do 40%, podczas gdy klasyczny keyword stuffing powoduje regres o 10% — ranking widoczności polskich domen w LLM mogą zmienić pięć filarów optymalizacji.

Filar 1: Nasycenie statystykami (Statistics Addition)

Zamiana ogólnikowych przymiotników marketingowych na ścisłe dane liczbowe to najlepiej performująca taktyka GEO — w testach na Perplexity podniosła widoczność źródła o 22%.

Gdy tekst twierdzi „większość użytkowników e-commerce robi zakupy rano” — asystent AI uznaje to za frazes. Zamień na: „w ankietach badawczych 72,4% konsumentów dokonało sesji logowania w oknie 7:00–11:00″ — i nagle artykuł ma wartość ekstrakcyjną. AI w procesie syntezy szuka nieopiniowalnego „mięsa” analitycznego. Konkretna liczba ułatwia szybkie generowanie argumentacji. Ogólnik? Ignorowany.

Filar 2: Ekspercka atrybucja zewnętrzna (Quotation Addition)

Implementacja weryfikowalnych cytatów ekspertów w znacznikach HTML (np. <blockquote>) z imieniem, nazwiskiem i tytułem autora to metoda o rekordowym wpływie na widoczność — wzrost cytowań o blisko 37% w badaniach Princeton.

Dlaczego to działa? Modele AI panicznie boją się halucynacji. Szukają gotowych cytatów uwierzytelnionych ekspertów zaszytych w skanowanym materiale, którymi mogą podeprzeć swoją odpowiedź — przerzucając odpowiedzialność merytoryczną na autora wypowiedzi. Artykuł o podatkach podparty dosłowną wypowiedzią dyplomowanego prawnika w ustrukturyzowanym bloku HTML staje się magnetem cytowań. Artykuł bez atrybuowanych wypowiedzi? Jeden z wielu.

Aleyda Solis z Orainti ujmuje to precyzyjnie:

„Optimize for citation-worthiness. It’s about establishing yourself as an authority in your field, but in order to do that, you have to make it very clear what your unique selling proposition is.”

(pol. Optymalizuj pod kątem bycia godnym cytowania. Chodzi o ugruntowanie pozycji autorytetu — musisz jasno określić swoją unikalną propozycję wartości.)

Być godnym cytowania — nie być widocznym. To różnica, która definiuje GEO.

Filar 3: Maszynowa czytelność i format Answer-First

Każdy logicznie wyodrębniony fragment strony (pod każdym nagłówkiem H2/H3) musi otwierać się od bezpośredniej, 40–60-wyrazowej odpowiedzi na pytanie zawarte w śródtytule — to właśnie te fragmenty są wyłuskiwane przez proces ekstrakcji semantycznej i stają się rdzeniem cytowanego „wyniku” w odpowiedzi AI.

Struktura „Odwróconej Piramidy” (Answer-First) redukuje koszt poznawczy maszyny do minimum. Tabelaryczne zestawienia, listy numeryczne i zwarte akapity (2–3 zdania) wykazują mierzalnie najlepszą responsywność w procesowaniu RAG — na poziomie efektywności ekstrakcji rzędu 0,648.

Reszta treści pod zwartą odpowiedzią — rozwinięcie, kontekst, przykłady — nadal ma wartość dla czytelnika. Ale dla bota jest balastem kontekstowym. Sedno odpowiedzi musi znajdować się w pierwszych dwóch zdaniach pod nagłówkiem. Nie w trzecim akapicie po rozbudowanym wstępie. W pierwszym. Zawsze.

Filar 4: Implementacja Schema i budowanie encji

Domeny nieposiadające struktury Schema (JSON-LD) pozostają niewidoczne dla systemów wyłapujących AI Overviews — przejście z paradygmatu słów kluczowych na paradygmat encji (zdefiniowanych bytów o stałych wektorach) wymaga rygorystycznego flagowania treści znacznikami strukturalnymi.

Minimum to: protokoły FAQPage, rozbudowany Article (z dateModified i danymi eksperta), HowTo. Złotym standardem jest silna inkorporacja relacji z siecią Semantic Web — atrybut sameAs w profilu biznesowym, adresujący botom, że podmiot istnieje jako zweryfikowana encja w Wikidata (ponad 500 miliardów faktów) i LinkedIn.

Ta „polisa ubezpieczeniowa” utwierdza logikę botów, że generują i polecają rynkowego stabilnego gracza — nie sztuczną platformę-wydmuszkę. Moim zdaniem to najczęściej pomijany element strategii GEO w polskich firmach, bo wdrożenie Schema wymaga współpracy SEO z programistami. A ta rzadko przebiega gładko.

Filar 5: Dywersyfikacja Earned Media — budowanie konsensusu zewnętrznego

Firmy obecne jednocześnie w co najmniej czterech odseparowanych środowiskach rynkowych (redakcyjne opinie branżowe, wideo-recenzje na YouTube, moderowane społeczności, agregatory typu Ceneo/G2) zyskują 2,8-krotne wzmocnienie szansy na cytowanie przez bota — modele AI szukają „ogólnego echa rynkowego” (Cross-Platform Consensus).

Lekcja z upadku dominacji Reddita we jest jednoznaczna: skupienie na jednym kanale to ryzyko. Trwała widoczność w LLM wymaga wielowymiarowej gęstości obecności marki — od publikacji u wiodących wydawców branżowych, przez wideo-recenzje autorytetów z YouTube, po realne dyskusje na moderowanych forach. Nie chodzi o spamowanie. Chodzi o realne istnienie w wielu miejscach naraz.

Masowe zaplecze z bezwartościowymi linkami? Przeszłość. Przyszłość przejmują ci, którzy zrozumieli, że 94% contentu w sieci nie zdobywa żadnych naturalnych linków (Backlinko, 2025) — a jednocześnie potrafią tworzyć treści na tyle unikalne, że inne serwisy chcą do nich linkować organicznie.

| Metoda optymalizacji GEO | Estymowana zmiana widoczności w AI |

|---|---|

| Quotation Addition (cytaty ekspertów w ustrukturyzowanym bloku) | +28,9% do blisko 37% |

| Cite Sources (zewnętrzna bibliografia linkująca z własnej strony) | +22,5% do 31,4% |

| Statistics Addition (parametryzowanie ogólników liczbami) | +21% do 22% |

| Fluency Optimization (płynność i czytelność formatu) | +20,4% |

| Keyword Stuffing (klasyczne spamowanie frazą) | -10% (degradacja statusu) |

Co to oznacza dla polskiego e-commerce w 2026 roku

Ranking widoczności polskich domen w LLM jednoznacznie potwierdza: pozycja w TOP 1 Google utraciła magiczną korelację z widocznością dla użytkownika (erozja z 76% do 37–38%), a firmy stojące przed wyborem między reaktywnym SEO a proaktywnym GEO mają na decyzję coraz mniej czasu.

Tradycyjna praca pod wyszukiwarki pozostaje fundamentem technicznym — boty muszą mieć ścieżki wejścia. Ale sam fundament nie wystarczy. Sektory o najostrzejszej konkurencji (e-commerce zdominowany przez Allegro i Ceneo, finanse strzeżone przez Bankier.pl i Money.pl, zdrowie pod kuratelą doz.pl i mp.pl) wymagają budowania silnej, wielowymiarowej encji: nasyconej statystykami, podpartej eksperckimi cytatami, ustrukturyzowanej tabelarycznie i rozproszonej w wielu zaufanych węzłach internetu.

Ruch z cytowań AI jest nieporównywalnie cenniejszy od tradycyjnego ruchu organicznego — konwersja 23-krotnie wyższa, wartość wizytora 4,4–5 razy większa. Firmy, które wdrożą rygorystyczne wytyczne GEO — odwrócenie lejków publikacji, dywersyfikację Earned Media, monitorowanie AI Share of Voice — zbudują przewagę, której konkurencja nie nadrobi wyłącznie budżetem reklamowym. Bo tu nie chodzi o pieniądze. Chodzi o Information Gain.

Przed polskim sektorem e-commerce stoi epokowe wyzwanie: albo szybkie wdrożenie strategii Generative Engine Optimization, albo cicha utrata pozycji w przedzakupowej świadomości cyfrowej użytkownika. Trzeciej drogi nie ma.